拡散モデルによるテキストから 3D への変換は、近年目覚ましい進歩を遂げています。

ただし、既存の手法は、推論の遅さ、多様性の低さ、ヤヌス問題といったスコア蒸留ベースの最適化に依存しているか、フィードフォワード手法であるため、3D トレーニング データの不足により低品質の結果が生成されます。

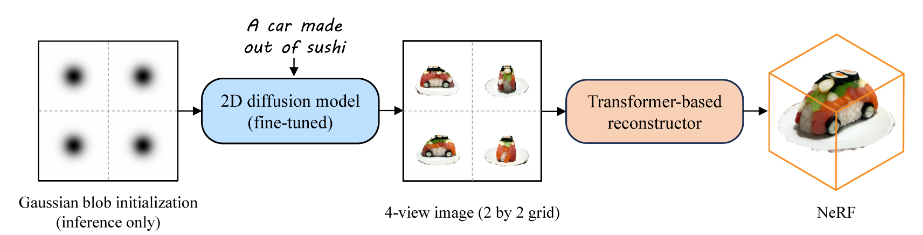

本稿では、テキストプロンプトからフィードフォワード方式で高品質かつ多様な 3D アセットを生成する新しい手法である Instant3D を提案します。私たちは 2 段階のパラダイムを採用しています。

このパラダイムでは、まず、微調整された 2D テキストから画像への拡散モデルを使用して、テキストから 4 つの構造化された一貫したビューのまばらなセットを 1 ショットで生成し、次に生成された画像から NeRF を直接回帰します。

新しいトランスフォーマベースのスパースビュー再構成器。広範な実験を通じて、私たちの方法が高品質で多様なヤヌスフリーの 3D アセットを 20 秒以内に生成できることを実証しました。これは、1 ~ 10 時間かかる可能性がある以前の最適化ベースの方法よりも 2 桁高速です。

プロジェクトのウェブページ

Instant3D- スパースビュー生成と大規模な再構成モデ–ルによる高速テキストから 3D への変換

広範な実験を通じて、私たちの方法が高品質で多様なヤヌスフリーの 3D アセットを 20 秒以内に生成できることを実証しました。 これは、1 ~ 10 時間かかる可能性がある以前の最適化ベースの方法よりも 2 桁高速です

図1。Instant3D のパイプライン全体。比較的少量の 3D データ (10K 形状) を使用して安定拡散を微調整して、2 × 2 のグリッド画像を生成します。各象限には、固定カメラ位置での同じオブジェクトのビューが含まれます。トランスフォーマベースの再構成器は、これら 4 つのビュー画像を取り込み、NeRF のトリプレーン表現を出力します。

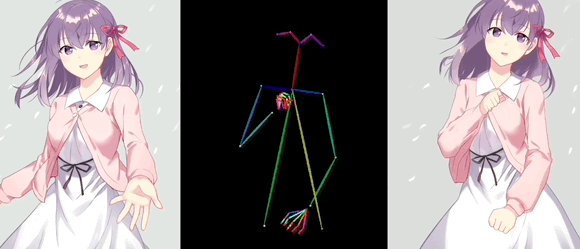

2D画像を 3Dモデル に変換

プロンプトからの3Dモデル生成

ネクタイをしてオフィスの椅子に座っているパンダ

折り紙のバイク

チェスをする 2 羽のコンゴウインコのオウム

青いバイク

ネクタイをしてオフィスの椅子に座っているパンダ